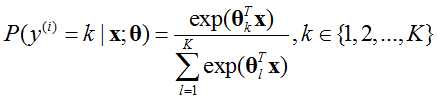

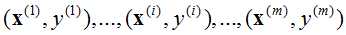

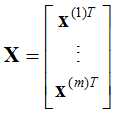

对于一般训练集:

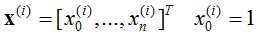

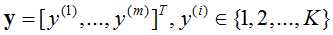

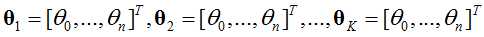

系统参数为:

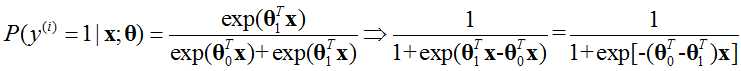

当Softmax回归用于2分类问题,那么可以得到:

令θ=θ0-θ1,就得到了logistic回归。所以实际上logistic回归虽然有2个参数向量,但这2个参数向量可以退化到1个参数向量。推广到K个类别,那么就需要K-1个参数向量

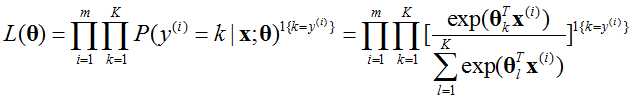

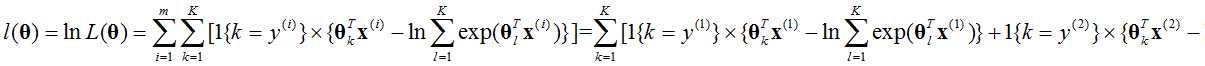

类似于logistic regression,求最大似然概率,有:

其中1{k=y}为真值表达式,例如如果1{1+1=2},那么值为1,如果1{1+1=0},那么值为0。对数似然函数有:

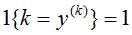

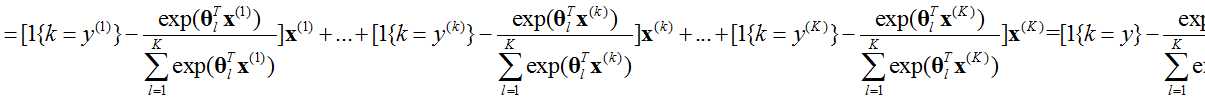

上式中,仅有 ,所以有:

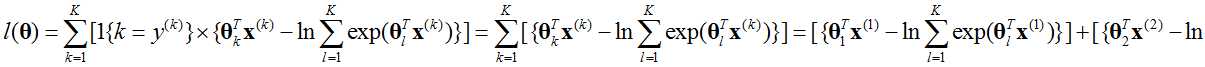

,所以有:

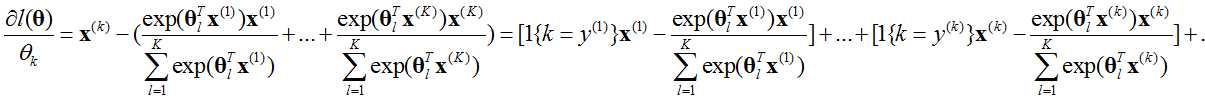

对上式求导数

Softmax回归(Softmax Regression, K分类问题)

原文:http://www.cnblogs.com/hgl0417/p/6670913.html