1.结构化:

2.转换成pandas的数据结构DataFrame

3.从DataFrame保存到excel

4.从DataFrame保存到sqlite3数据库

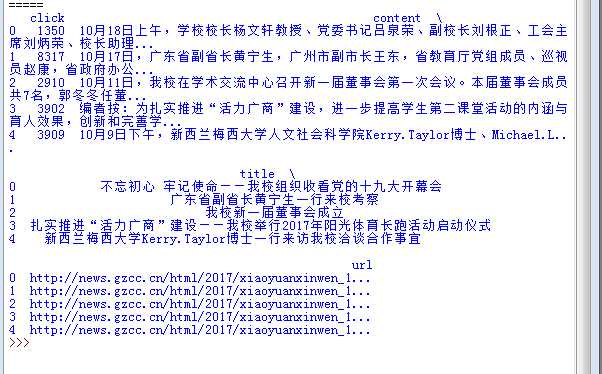

import requests from bs4 import BeautifulSoup from datetime import datetime import pandas import re def getclick(url): id=re.search(‘_(.*).html‘,url).group(1).split(‘/‘)[1] clickurl=‘http://oa.gzcc.cn/api.php?op=count&id={}&modelid=80‘.format(id) click=int(requests.get(clickurl).text.split(‘.‘)[-1].lstrip("html(‘").rstrip("‘);")) return click def getdetail(url): resd=requests.get(url) resd.encoding=‘utf-8‘ soupd=BeautifulSoup(resd.text,‘html.parser‘) news={} news[‘title‘]=soupd.select(‘.show-title‘)[0].text news[‘url‘]=url info=soupd.select(‘.show-info‘)[0].text news[‘content‘]=soupd.select(‘.show-content‘)[0].text.strip() news[‘click‘]=getclick(url) return(news) def onepage(pageurl): res=requests.get(pageurl) res.encoding=‘utf-8‘ soup = BeautifulSoup(res.text,‘html.parser‘) newsls=[] for news in soup.select(‘li‘): if len(news.select(‘.news-list-title‘))>0: newsls.append(getdetail(news.select(‘a‘)[0][‘href‘])) return(newsls) ns=[] gzccurl=‘http://news.gzcc.cn/html/xiaoyuanxinwen/‘ ns.extend(onepage(gzccurl)) res=requests.get(gzccurl) res.encoding=‘utf-8‘ soup = BeautifulSoup(res.text,‘html.parser‘) pages=int(soup.select(‘.a1‘)[0].text.rstrip(‘条‘)) for i in range(2,3): listurl=‘http://news.gzcc.cn/html/xiaoyuanxinwen/{}.html‘.format(i) ns.extend(onepage(listurl)) df=pandas.DataFrame(ns) print(df.head()) df.to_excel(‘gzccnews.xlsx‘)

原文:http://www.cnblogs.com/zsc-leo/p/7691457.html