【中文翻译】

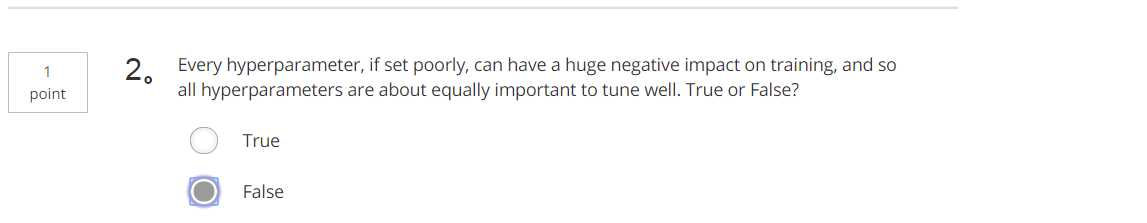

2、每个 hyperparameter, 如果设置不佳, 会对训练产生巨大的负面影响, 所以所有的参数都同样重要, 可以很好地调整。真的还是假的?

【中文翻译】

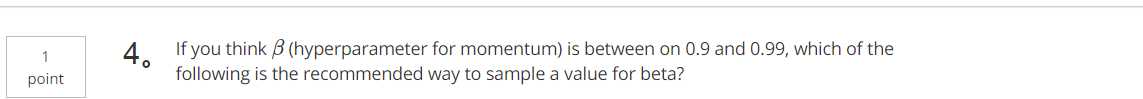

4、如果你认为β (hyperparameter 为动量) 在0.9 和0.99 之间, 以下是推荐的方法为 beta 的值抽样?

【中文翻译】

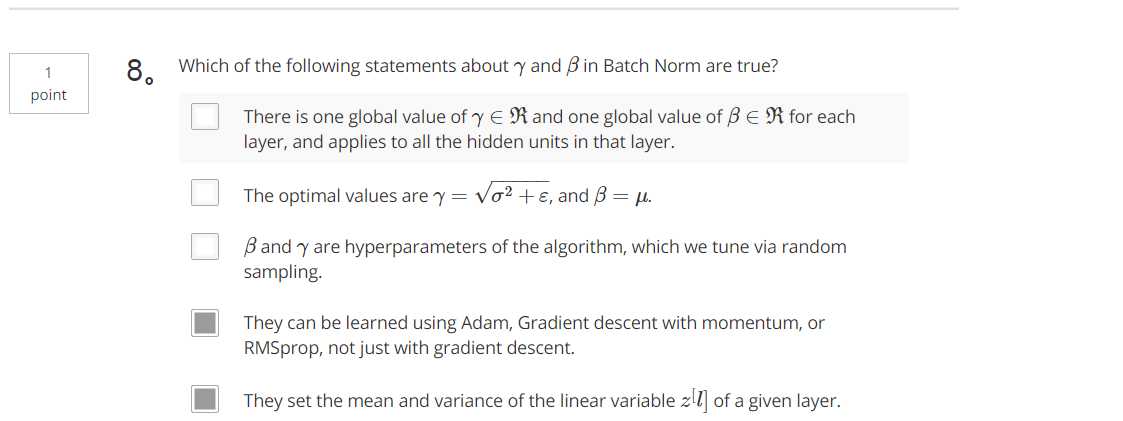

8、以下哪一项关于γ和β在Batch Norm 中的陈述是真的?

每个层都有一个全局值γ∈R 和一个全局值β∈R, 并适用于该层中的所有隐藏单元。

最优的值是 和β = μ。

和β = μ。

β和γ是算法的参数, 我们通过随机抽样进行调整。

他们可以使用Adam, 动量梯度下降与,或 RMSprop训练, 不只是与梯度下降。

它们设置给定层的线性变量 z [l] 的平均值和方差。