theta->weights

sigmoid->activation function

input_layer->hidden_layer->output_layer

对每一个隐藏层的操作等同于Logistic Regression。因此,通过BP神经网络可以建立比Logistic Regression更复杂的非线性假设,

且建模形式更简洁。

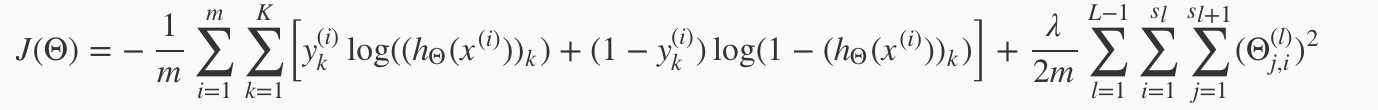

其中,K是输出层的单元数(类别数)

默认:输入层+1个隐藏层+输出层

多个隐藏层时,建议每个隐藏层的单元数一致

吴恩达Machine Learning学习笔记(四)--BP神经网络

原文:https://www.cnblogs.com/lypniuyou/p/9537544.html