Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架,非常出名,非常强悍。所谓的框架就是一个已经被集成了各种功能(高性能异步下载,队列,分布式

,解析,持久化等)的具有很强通用性的项目模板。对于框架的学习,重点是要学习其框架的特性、各个功能的用法即可。

Linux: pip3 install scrapy Windows: a. pip3 install wheel b. 下载twisted http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted c. 进入下载目录,执行 pip3 install Twisted?17.1.0?cp35?cp35m?win_amd64.whl d. pip3 install pywin32 e. pip3 install scrapy

其实:应该还要装一个lxml,这之前在使用xpath的时候已经装了

1.在命令行中使用命令进入即将创建爬虫项目的文件夹

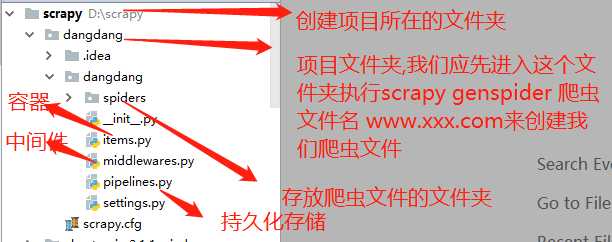

2.在命令行执行 scrapy starproject 爬虫项目名称(就会在当前文件夹创建项目名称的文件夹) ---->创建项目

3.在命令行执行 cd 项目名称文件夹

4.在命令行执行 scrapy genspider 爬虫文件名称 www.xxx.com -----创建爬虫文件(存放在spider文件夹)

执行完毕后,会在项目的spiders中生成一个应用名的py爬虫文件

5.

5.5.

注:各个文件描述:

scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

items.py 设置数据存储模板,用于结构化数据,如:Django的Model pipelines 数据持久化处理

settings.py 配置文件,如:递归的层数、并发数,延迟下载等

spiders 爬虫目录,如:创建文件,编写爬虫解析规则

scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

items.py 设置数据存储模板,用于结构化数据,如:Django的Model pipelines 数据持久化处理

settings.py 配置文件,如:递归的层数、并发数,延迟下载等 spiders 爬虫目录,如:创建文件,编写爬虫解析规则

import scrapy class QiubaiSpider(scrapy.Spider): name = ‘qiubai‘ #应用名称 #允许爬取的域名(如果遇到非该域名的url则爬取不到数据) allowed_domains = [‘https://www.qiushibaike.com/‘] #起始爬取的url start_urls = [‘https://www.qiushibaike.com/‘] #访问起始URL并获取结果后的回调函数,该函数的response参数就是向起始的url发送请求后,获取的响应对象.该函数返回值必须为可迭代对象或者NUll def parse(self, response): print(response.text) #获取字符串类型的响应内容 print(response.body)#获取字节类型的相应内容

在stttings文件中:修改配置:

1.修改robots协议,表示我们不准从robots协议

ROBOTSTXT_OBEY = False

2.UA伪装

默认是这样的:USER_AGENT = ‘firstblood (+http://www.yourdomain.com)‘

修改:USER_AGENT = ‘Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko)

Chrome/63.0.3239.26 Safari/537.36 Core/1.63.6821.400 QQBrowser/10.3.3040.400‘

1.在命令行进入所在项目文件夹

2. 执行scrapy crawl 爬虫文件名称 --nolog (表示不打印日志)

原文:https://www.cnblogs.com/tjp40922/p/10458040.html