主要功能包括分词,添加自定义词典,关键词提取,词性标注,并行分词,Tokenize:返回词语在原文的起始位置,命令行分词等功能。

代码对 Python 2/3 均兼容

全自动安装:easy_install jieba 或者 pip install jieba / pip3 install jieba

半自动安装:先下载 http://pypi.python.org/pypi/jieba/ ,解压后运行 python setup.py install

手动安装:将 jieba 目录放置于当前目录或者 site-packages 目录

通过 import jieba 来引用

同时利用wordcloud,matplotlib库来制作图云

安装完jieba库之后,我们可以利用其来获得文章中的词频。

分析刘慈欣小说《三体》(一二三部合集)出现次数最多的词语。

首先下载好《三体》以txt格式、utf-8编码。导入jieba库:

import jieba

打开文件:

txt = open("santi.txt", encoding="utf-8").read()

使用全模式进行分词,返回列表:

words = jieba.lcut(txt)

定义空集合,并借此进行进行统计:

counts = {} for word in words: counts[word] = counts.get(word,0) + 1

dict_items转换为列表,并以第二个元素排序:

items = list(counts.items()) items.sort(key=lambda x:x[1], reverse=True)

以格式化打印前30名:

for i in range(30): word, count = items[i] print ("{0:<10}{1:>5}".format(word, count))

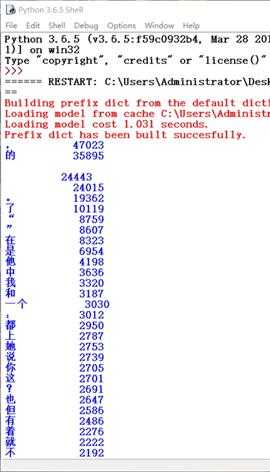

运行结果如下图

由于其中太多无意义的符号,使用停用词表来筛选

原文:https://www.cnblogs.com/z2273533704/p/10652526.html