(转载请注明出处:http://blog.csdn.net/buptgshengod)

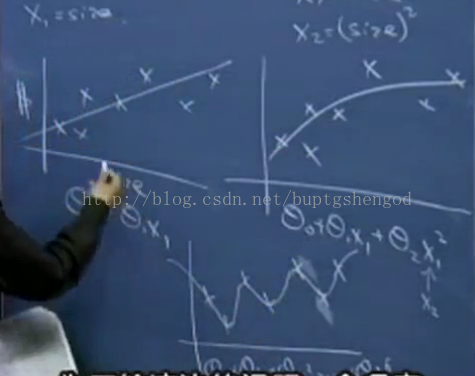

比方说我们有一个特征值X。就是easy造成欠拟合,由于这个结论是一条直线。

可是,当我们把x平方,。这个式子就会得到比較好的拟合。

可是当我们把x三次方。四次方。。。

都加上,就会出现过拟合。

这三种情况分别相应下图的左1。右1,下。

是通过所有数据集拟合出每一个特征值相应的參数。在linear regression中,我们预測一个x它所相应的y。我们仅仅要找到这个x周边的数值,拟合一条直线出来,就能够了。

设噪声符合高斯分布,然后在log下推导。推出了用最小二乘法是推断预測结果的形式。

之后就是通过上一节讲的梯度下降法的变形拟合出逻辑回归的每一个參数。

斯坦福机器学习公开课学习笔记(3)—拟合问题以及局部权重回归、逻辑回归

原文:https://www.cnblogs.com/ldxsuanfa/p/10661832.html