原文地址:

https://jinxin0924.github.io/2017/12/21/AutoML%E6%80%BB%E7%BB%93/

Posted by JxKing on December 21, 2017

---------------------------------------------------------------------------------------------------------------

AutoML是指尽量不通过人来设定超参数,而是使用某种学习机制,来调节这些超参数。这些学习机制包括传统的贝叶斯优化,(multi-armed bandit),进化算法,还有比较新的强化学习。

我将AutoML分为传统AutoML ,自动调节传统的机器学习算法的参数,比如随机森林,我们来调节它的max_depth, num_trees, criterion等参数。 还有一类AutoML,则专注深度学习。这类AutoML,不妨称之为深度AutoML ,与传统AutoML的差别是,现阶段深度AutoML,会将神经网络的超参数分为两类,一类是与训练有关的超参数,比如learning rate, regularization, momentum等;还有一类超参数,则可以总结为网络结构。对网络结构的超参数自动调节,也叫 Neural architecture search (nas) 。而针对训练的超参数,也是传统AutoML的自动调节,叫 Hyperparameter optimization (ho) 。

贝叶斯优化是一种近似逼近的方法,用各种代理函数来拟合超参数与模型评价之间的关系,然后选择有希望的超参数组合进行迭代,最后得出效果最好的超参数组合。

| 算法 | 代理函数 | 采集函数 | 优缺点 |

|---|---|---|---|

| BO | 高斯过程 | Expected Improvement | 应用广泛,在低维空间表现出色 |

| SMAC | 回归随机森林 | Upper Confidence Bound | 对离散型变量表现出色 |

| TPE | 高斯混合模型 | Expected Improvement | 高维空间表现出色,有论文表明最实用 |

需要消耗大量资源及时间。由于需要至少几十次迭代,即需要训练几十次的模型,因而会造成大量资源、时间消耗。基于这个特点,可以说贝叶斯优化算法适合传统AutoML ,而不适合深度AutoML

效果不稳定。由于初始化存在随机性,其效果不稳定。也有论文表明,贝叶斯优化算法并不显著优于随机搜索(random search)

multi-armed bandit是非常经典的序列决策模型,要解决的问题是平衡“探索”(exploration)和“利用”(exploitation)。

举一个bandit例子,你有20个按钮,每个按钮按一次可能得到一块钱或者拿不到钱,同时每个按钮的得到一块钱的概率不同,而你在事前对这些概率一无所知。在你有1000次按按钮的机会下,呼和得到最大收益。

这类算法,通过将自动调参问题,转化为bandit问题,配置更多资源给表现更优异的参数模型。

Hyperband是一个颇具代表的算法。总体思路我们由一个自动调节LeNet的例子来展示:

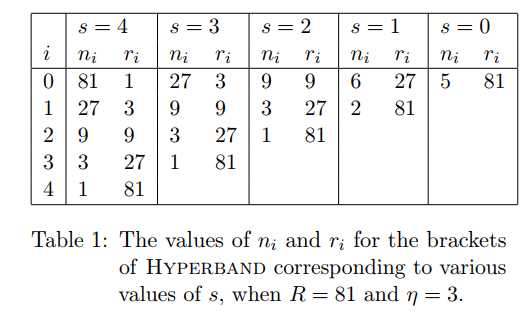

R=81代表总资源,$\mu$ 代表每次筛选的比例,ni代表参数配置的组合数,ri代表资源数,这里代表一个epoch,第一行代表随机得到ni个参数配置,然后经过第ri次迭代之后,根据模型validation loss选择出top k个表现好的模型,继续下一行ri的训练。

一般的进化算法其实大同小异,差别在如何选择变异,有比较细的变异,比如在Large-Scale Evolution of Image Classifiers 这篇文章中,就定义了非常具体的变异,比如有改变通道数量,改变filter大小,改变stride等等;而在Simple And Efficient Architecture Search for Convolutional Neural Networks这篇论文中,它的变异,就借鉴了现有公认的比较好的结构,加深网络就用conv-bn-relu3件套,加宽网络加大通道数量,增加skip connection。

这些进化算法在做自动模型选择时,每次迭代都不可避免的需要在整个数据集上跑若干个epoch,而每次迭代都有许多个变异,又需要很多次迭代,导致最后的训练时间太久。

Simple And Efficient Architecture Search for Convolutional Neural Networks 这篇论文提出,我们先用一个成熟的模型去训练(也可以fine-tune训练),然后在这个模型的基础上去变异,变异之后用fine-tune训练几个epoch即可。这带来两个好的结果:

个人认为,这篇论文很有实际意义。

SMASH: One-Shot Model Architecture Search through HyperNetworks 在这篇论文中,介绍了一种利用辅助网络给不同的网络初始化参数,从而无需重训练的方法。

其大致流程是在一堆待搜索的网络结构中,随机挑选数据和网络结构,用辅助网络负责参数初始化,然后训练用梯度下降训练这个辅助网络。在该辅助网络训练的足够好之后,就可以用它给各个不同的网络初始化参数,然后测试validation loss,最后挑出最优的网络结构,从头开始正常训练。

该方法通过训练一次辅助网络,避免每个网络都需要训练的情况,使得训练时间大大减小。该方法非常具有参考意义。

强化学习在nas和ho两方面都有应用。

Learning Transferable Architectures for Scalable Image Recognition

用RNN作为controller,产生网络结构,然后根据收敛精度调节rnn。

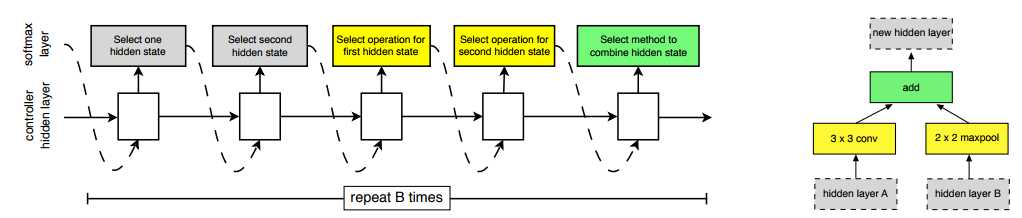

将整个网络分为两种cell,Normal cell 和 Reduction cell,每个cell有B个block组成,而一个cell由rnn生成的过程如图所示:

该方法现在cifar10上寻找到两种cell的结构,然后迁移到imagenet上。

值得注意的是,该方法虽然效果惊人,但是人为的提前设定非常多:

因此在这个网络结构的搜索中,模型的探索空间有限,同时它在cifar10上进行训练,因此它的速度还不错。

Neural Optimizer Search with Reinforcement Learning

用RNN作为optimizer的controller,产生optimizer,然后用小的cnn模型训练5个epoch,得到的val_acc作为reward,训练。

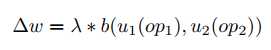

将每个optimizer抽象的表达为:

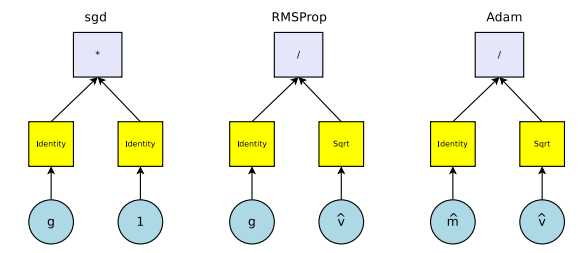

比如:

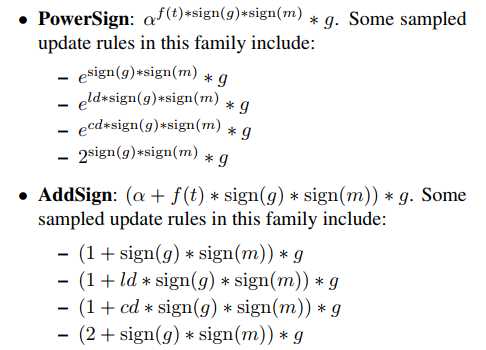

最后产生了两类optimizer:

原文:https://www.cnblogs.com/devilmaycry812839668/p/10799574.html