exponential_decay(learning_rate, global_steps, decay_steps, decay_rate, staircase=False, name=None)

使用方式:

tf.tf.train.exponential_decay()

例子:

tf.train.exponential_decay(self.config.e_lr, self.e_global_steps,self.config.decay_steps, self.config.decay_rate, staircase=True)

在 Tensorflow 中,exponential_decay()是应用于学习率的指数衰减函数(实现指数衰减学习率)。

在训练模型时,通常建议随着训练的进行逐步降低学习率。该函数需要`global_step`值来计算衰减的学习速率。

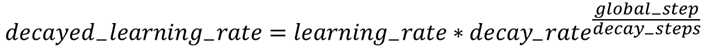

该函数返回衰减后的学习率。该函数的计算方程式如下

参数:

返回值:

优点:

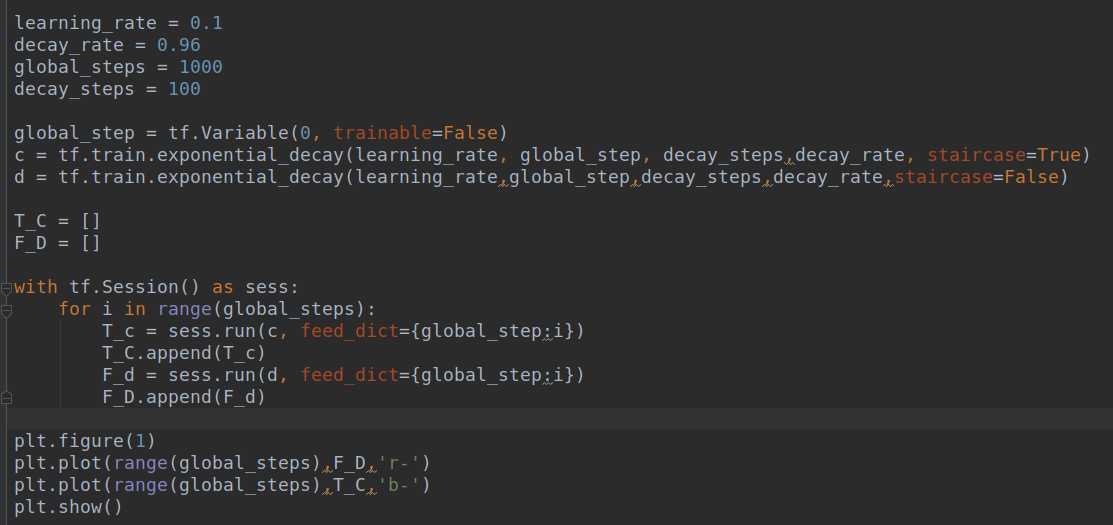

示例代码:

import tensorflow as tf

import matplotlib.pyplot as plt

learning_rate = 0.1

decay_rate = 0.96

global_steps = 1000

decay_steps = 100

global_step = tf.Variable(0, trainable = Fasle)

c = tf.train.exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase=True)

d = tf.train.exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase=False)

T_C = []

F_D = []

with tf.Session() as sess:

for i in range(global_steps):

T_c = sess.run(c, feed_dict={global_step: i})

T_C.append(T_c)

F_d = sess.run(d, feed_dict={global_step: i})

F_D.append(F_d)

plt.figure(1)

plt.plot(range(global_steps), F_D, ‘r-‘)

plt.plot(range(global_steps), T_C, ‘b-‘)

plt.show()

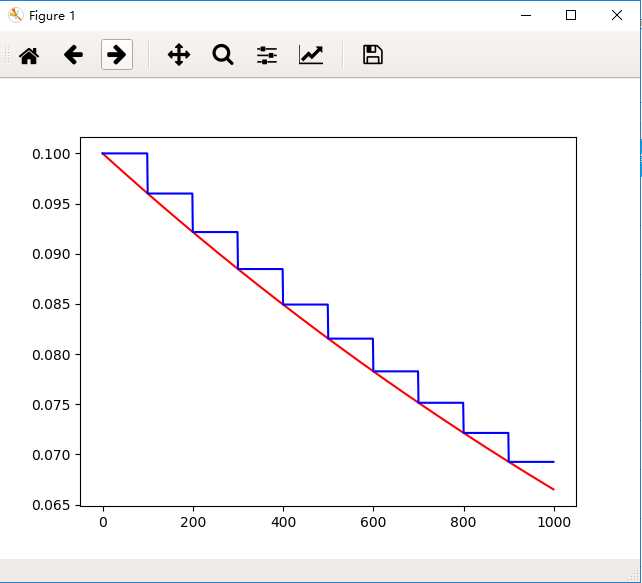

实操:

运行结果:

备注:

(1)

台阶形状的蓝色线是 staircase = True

线条形状的红色线是 staircase = Fasle

(2)

初始学习率 learning_rate 为0.1,总训练次数 global_setps 为 1000 次;staircase=True时,每隔 decay_steps = 100 次更新一次 学习率 learning_rate,而staircase=True时,每一步均会更新一次学习率 learning_rate ,

(3)

训练过程中,decay_rate的数值保持步不变。

参考文献:https://www.cnblogs.com/gengyi/p/9898960.html

tensorflow之tf.train.exponential_decay()指数衰减法

原文:https://www.cnblogs.com/happystudyeveryday/p/11144433.html