拉普拉斯矩阵是个非常巧妙的东西,它是描述图的一种矩阵,在降维,分类,聚类等机器学习的领域有很广泛的应用。

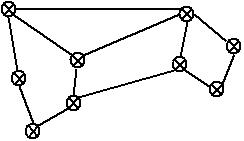

先说一下什么是拉普拉斯矩阵,英文名为Laplacian matrix,其具体形式得先从图说起,假设有个无向图如下所示,

性质:

(1)是半正定矩阵。

(2)的最小特值为0,对应特向为全1列向量。

(3)对有个非负实特征值,.

(4)对于任意一个属于实向量,都有此公式成立:

它又有什么用处呢?跟目标是有关系的,哈哈~

证明如下: 为的实数列向量

因为所以

拉普拉斯特征映射将处于流形上的数据,在尽量保留原数据间相似度的情况下,映射到低维下表示。

其步骤如下:

1. 构造近邻图(用近邻图图近似流形)

1.1 近邻条件, 表示第个样本。

1.2 K近邻

2. 计算边权重(即样本间相似度)

2.1 热核

2.2 简单形式

3. 特征映射

求解;广义特征值问题。

得到解如下:(特向和特值)

取小的前个来嵌入到维欧氏空间里。

至于为神马,愣是没有看出所以然来,哎~

倒腾了一大通,终于把为什么目标等价于给搞明白了。

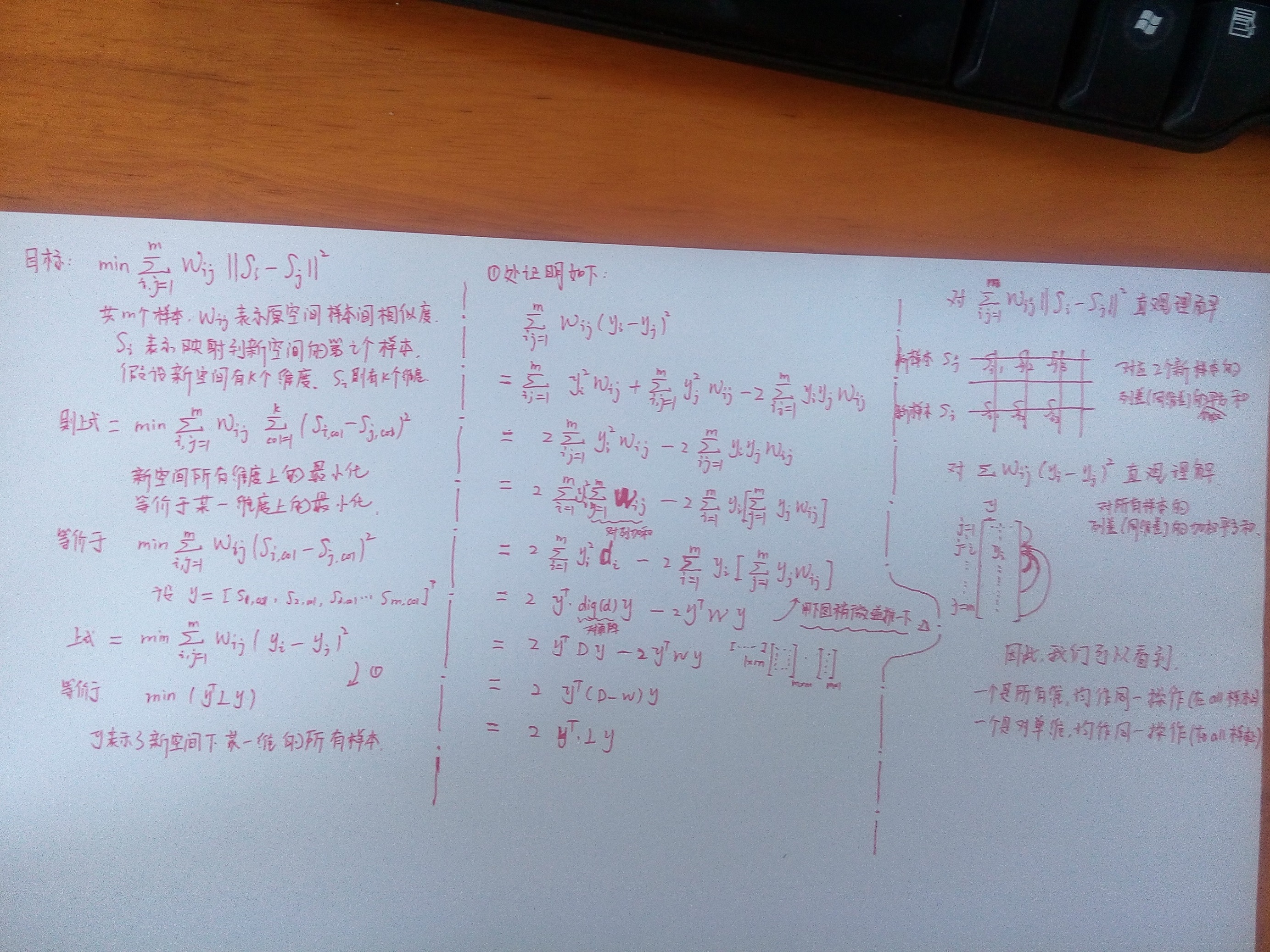

具体解释如下图所示:(左侧是基本思路,中间是核心推导,右侧是直观理解)

求解广义特征向量,取前几个非零最小特值对应的特向,即为原数据在低维下的表示。

三个概念:

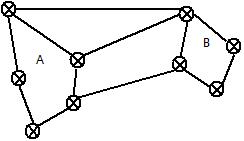

(1)对于邻接矩阵,定义图中A子图与B子图之间的所有边的权重之和为:

为所有边的权重,及样本间相似度矩阵。

(2)与某点的所有边的权重和定义为该顶点的度

(3)Graph Cut,就是把一个图的一些边切断,把一个图变为若干独立的子图,而这些被切断的边的权重之和称为Cut值。

对于如下图,我们想找到某个割把整个图分成两个子图。

1)拉普拉斯矩阵是一种图的矩阵表示。

2)拉普拉斯映射是在保持原流形数据相似度的情况下,直接降维到低维空间。

3)谱聚类是通过最小割,刚好借助了拉普拉斯映射的思想,从而用携带切割信息的特向来表征原流形数据,再去聚类。(相比于传统聚类,谱聚类更侧重于数据相似度信息的保留,更具有针对性,计算效率也更高)

三者紧密联系,又不能混为一谈。

几个参考:

1)化二次型为标准型

http://student.zjzk.cn/course_ware/web-gcsx/gcsx/chapter5/chapter5_2_1.htm

2)一个关于拉普拉斯矩阵的博客

http://blog.sciencenet.cn/blog-261330-751483.html

3)一个谱聚类的博客

http://blog.pluskid.org/?p=287

4)广义特征值的介绍

http://webcache.googleusercontent.com/search?q=cache:_85fSHsIv3MJ:https://zh.wikipedia.org/zh-cn/%25E7%2589%25B9%25E5%25BE%2581%25E5%2590%2591%25E9%2587%258F+&cd=1&hl=zh-CN&ct=clnk&gl=cn&lr=lang_en%7Clang_zh-CN%7Clang_zh-

转自:http://blog.csdn.net/yujianmin1990/article/details/48420483,感谢分享!

原文:https://www.cnblogs.com/baiting/p/11531468.html