本篇是机器学习小组第五周的学习内容,内容主要摘录自以下学习链接:

降低损失 (Reducing Loss):梯度下降法

https://developers.google.cn/machine-learning/crash-course/reducing-loss/gradient-descent?hl=zh_cn

机器学习必备的数学知识,一次学会

https://gitbook.cn/books/5dc2c4067b9430477fe5961c/index.html

【数据科学家学习小组】之机器学习(第一期)第五周(20191201-20191208)

https://mp.weixin.qq.com/s/UN3p9ArkkGkFOOGIUc_BYw

1.梯度下降法理解

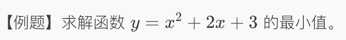

梯度下降法是求救函数极值的算法。从求解函数极值的过程看,假设需要求解下面函数的极值:

则可以使用代数法和求导法实现。通过代数法,我们将上述函数转换为:

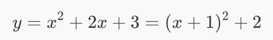

我们保证 取得最小值即可取得整个函数的极值。所以x=-1.通过求导法,我们得到:

取得最小值即可取得整个函数的极值。所以x=-1.通过求导法,我们得到:

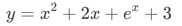

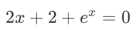

同理x=-1时方程满足,函数求解。但如果函数变为:

函数中出现了指数项,则代数法不再适用。通过求导:

但仍然无法直接计算x。所以这里需要借助梯度下降法求解。那么什么是梯度?

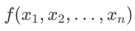

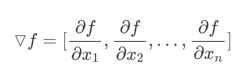

函数 的梯度定义式即为:

的梯度定义式即为:

那么梯度下降法到底是什么?

TODO

2.梯度下降法可视化

TODO

3.随机梯度下降

TODO

原文:https://www.cnblogs.com/favor-dfn/p/12005368.html