1. 文本编辑器存取文件的原理(nodepad++,pycharm,word)

打开编辑器就打开了启动了一个进程,是在内存中的,所以在编辑器编写的内容也都是存放与内存中的,断电后数据丢失,因而需要保存到硬盘上,点击保存按钮,就从内存中把数据刷到了硬盘上。在这一点上,我们编写一个py文件(没有执行),跟编写其他文件没有任何区别,都只是在编写一堆字符而已。

即:在没有点击保存时,我们所写的内容都是写入内存。注意这一点,很重要!!当我们点击保存,内容才被刷到硬盘。

上面做了两件事:写内容到内存,从内存将内存刷到硬盘。这是两个过程。

2. python解释器执行py文件的原理 ,例如python test.py

第一阶段:python解释器启动,此时就相当于启动了一个文本编辑器

第二阶段:python解释器相当于文本编辑器,去打开test.py文件,从硬盘上将test.py的文件内容读入到内存中

第三阶段:python解释器解释执行刚刚加载到内存中test.py的代码

python解释器执行py文件分为两个步骤:1.将文件读到内存,2.解释执行内容。

要搞清楚字符编码,首先要解决的问题是:什么是字符编码?

我们都知道,计算机要想工作必须通电,也就是说‘电’驱使计算机干活,而‘电’的特性,就是高低电平(高低平即二进制数1,低电平即二进制数0),也就是说计算机只认识数字(010101).如果我们想保存数据,首先得将我们的数据进行一些处理,最终得转换成010101才能让计算机识别。

所以必须经过一个过程:

字符--------(翻译过程)------->数字

这个过程实际就是一个字符如何对应一个特定数字的标准,这个标准称之为字符编码。

那么问题就来了?作为一种编码方案,还得解决两个问题:

a.字节是怎么分组的,如8 bits或16 bits一组,这也被称作编码单元。

b.编码单元和字符之间的映射关系。例如,在ASCII码中,十进制65映射到字母A上。

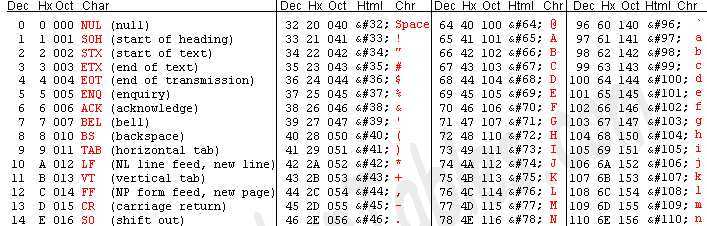

ASCII码是上个世纪最流行的编码体系之一,至少在西方是这样。下图显示了ASCII码中编码单元是怎么映射到字符上的。

阶段一:现代计算机起源于美国,最早诞生也是基于英文考虑的ASCII

ASCII,一个Bytes代表一个字符(英文字符/键盘上的所有其他字符),1Bytes=8bit,8bit可以表示0-2**8-1种变化,即可以表示256个字符,ASCII最初只用了后七位,127个数字,已经完全能够代表键盘上所有的字符了(英文字符/键盘的所有其他字符),后来为了将拉丁文也编码进了ASCII表,将最高位也占用了。

阶段二:为了满足中文,中国人定制了GBK

GBK:2Bytes代表一个字符;为了满足其他国家,各个国家纷纷定制了自己的编码。日本把日文编到Shift_JIS里,韩国把韩文编到Euc-kr里

阶段三:万国码Unicode编码

后来,有人开始觉得太多编码导致世界变得过于复杂了,让人脑袋疼,于是大家坐在一起拍脑袋想出来一个方法:所有语言的字符都用同一种字符集来表示,这就是Unicode。

在UTF-8中:

0100100001000101010011000100110001001111

这个字节流在ASCII和UTF-8中表示相同的字符:HELLO

至于其他的UTF-16,这里就不再叙述了。

总结一点:

因此:

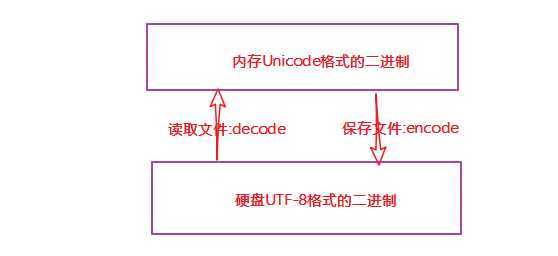

总结:所有程序,最终都要加载到内存,程序保存到硬盘不同的国家用不同的编码格式,但是到内存中我们为了兼容万国(计算机可以运行任何国家的程序原因在于此),统一且固定使用unicode,这就是为何内存固定用unicode的原因,你可能会说兼容万国我可以用utf-8啊,可以,完全可以正常工作,之所以不用肯定是unicode比utf-8更高效啊(uicode固定用2个字节编码,utf-8则需要计算),但是unicode更浪费空间,没错,这就是用空间换时间的一种做法,而存放到硬盘,或者网络传输,都需要把unicode转成utf-8,因为数据的传输,追求的是稳定,高效,数据量越小数据传输就越靠谱,于是都转成utf-8格式的,而不是unicode。

不管是哪种类型的文件,只要记住一点:文件以什么编码保存的,就以什么编码方式打开.

下面我们来看看python中关于编码出现的问题:

如果不在python文件指定头信息#-*-coding:utf-8-*-,那就使用默认的python2中默认使用ascii,python3中默认使用utf-8

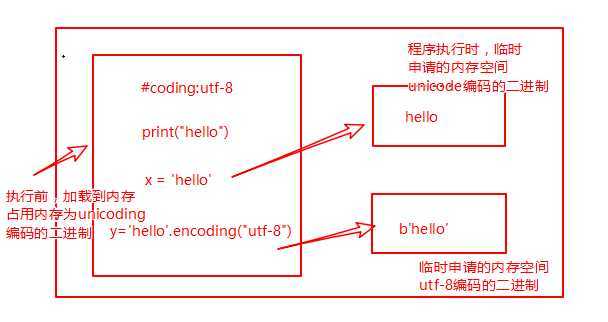

读取已经加载到内存的代码(unicode编码的二进制),然后执行,执行过程中可能会开辟新的内存空间,比如x="hello"

重点来啦:

内存的编码使用unicode,不代表内存中全都是unicode编码的二进制,

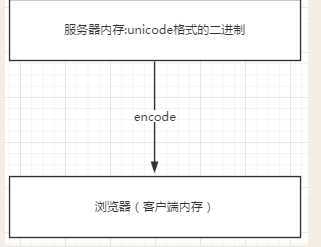

浏览网页的时候,服务器会把动态生成的Unicode内容转换为UTF-8再传输到浏览器

如果服务端encode的编码格式是utf-8, 客户端内存中收到的也是utf-8编码的二进制

1.在python2中有两种字符串类型str和unicode

str类型

当python解释器执行到产生字符串的代码时(例如s=‘林‘),会申请新的内存地址,然后将‘林‘编码成文件开头指定的编码格式,这已经是encode之后的结果了,所以s只能decode。再次encode就会报错。

#_*_coding:gbk_*_ 2 #!/usr/bin/env python 3 4 x=‘林‘ 5 # print x.encode(‘gbk‘) #报错 6 print x.decode(‘gbk‘) #结果:林

在python2中,str就是编码后的结果bytes,str=bytes,所以在python2中,unicode字符编码的结果是str/bytes。

#coding:utf-8 s=‘林‘ #在执行时,‘林‘会被以conding:utf-8的形式保存到新的内存空间中 print repr(s) #‘\xe6\x9e\x97‘ 三个Bytes,证明确实是utf-8 print type(s) #<type ‘str‘> s.decode(‘utf-8‘) # s.encode(‘utf-8‘) #报错,s为编码后的结果bytes,所以只能decode

Unicode类型

当python解释器执行到产生字符串的代码时(例如s=u‘林‘),会申请新的内存地址,然后将‘林‘以unicode的格式存放到新的内存空间中,所以s只能encode,不能decode.

s=u‘林‘ print repr(s) #u‘\u6797‘ print type(s) #<type ‘unicode‘> # s.decode(‘utf-8‘) #报错,s为unicode,所以只能encode s.encode(‘utf-8‘)

特别说明:

当数据要打印到终端时,要注意一些问题.

当程序执行时,比如:x=‘林‘;print(x) #这一步是将x指向的那块新的内存空间(非代码所在的内存空间)中的内存,打印到终端,而终端仍然是运行于内存中的,所以这打印可以理解为从内存打印到内存,即内存->内存,unicode->unicode.对于unicode格式的数据来说,无论怎么打印,都不会乱码.python3中的字符串与python2中的u‘字符串‘,都是unicode,所以无论如何打印都不会乱码.在windows终端(终端编码为gbk,文件编码为utf-8,乱码产生)

#分别验证在pycharm中和cmd中下述的打印结果 s=u‘林‘ #当程序执行时,‘林‘会被以unicode形式保存新的内存空间中 #s指向的是unicode,因而可以编码成任意格式,都不会报encode错误 s1=s.encode(‘utf-8‘) s2=s.encode(‘gbk‘) print s1 #打印正常否? print s2 #打印正常否 print repr(s) #u‘\u6797‘ print repr(s1) #‘\xe6\x9e\x97‘ 编码一个汉字utf-8用3Bytes print repr(s2) #‘\xc1\xd6‘ 编码一个汉字gbk用2Bytes print type(s) #<type ‘unicode‘> print type(s1) #<type ‘str‘> print type(s2) #<type ‘str‘>

2. 在python3中也有两种字符串类型str和bytes

str类型变为unicode类型

#coding:utf-8 s=‘林‘ #当程序执行时,无需加u,‘林‘也会被以unicode形式保存新的内存空间中, #s可以直接encode成任意编码格式 s.encode(‘utf-8‘) s.encode(‘gbk‘) print(type(s)) #<class ‘str‘>

bytes类型

#coding:utf-8 s=‘林‘ #当程序执行时,无需加u,‘林‘也会被以unicode形式保存新的内存空间中, #s可以直接encode成任意编码格式 s1=s.encode(‘utf-8‘) s2=s.encode(‘gbk‘) print(s) #林 print(s1) #b‘\xe6\x9e\x97‘ 在python3中,是什么就打印什么 print(s2) #b‘\xc1\xd6‘ 同上 print(type(s)) #<class ‘str‘> print(type(s1)) #<class ‘bytes‘> print(type(s2)) #<class ‘bytes‘>

原文:https://www.cnblogs.com/gengyufei/p/12638336.html