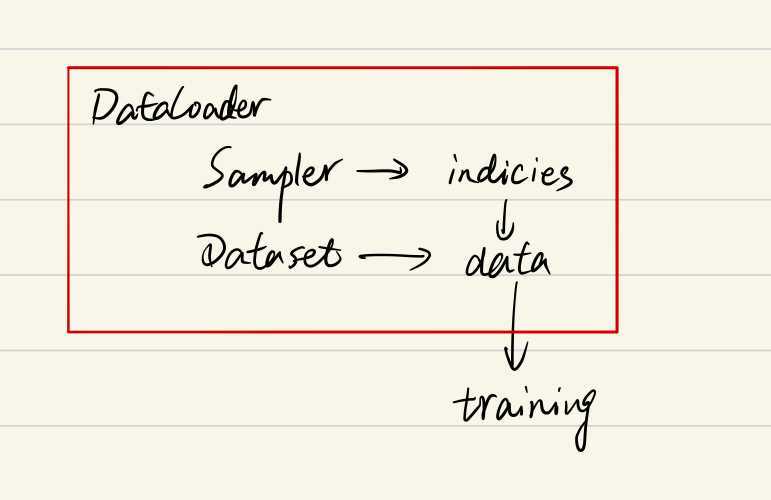

PyTorch中Dataset, DataLoader, Sampler的关系可用下图概括:

在PyTorch中数据传递机制是这样的:Dataset负责建立索引到样本的映射,DataLoader负责以特定的方式从数据集中迭代的产生一个个batch的样本集合。在enumerate过程中,Dataloader按照其参数BatchSampler规定的策略调用其Dataset的getitem方法batchsize次,得到一个batch,该batch中既包含样本,也包含相应的标签。

更详细的分析可参考以下资料:

PyTorch中Dataset, DataLoader, Sampler的关系

原文:https://www.cnblogs.com/picassooo/p/12853672.html