复杂度是衡量代码运行效率的重要的度量因素。主要包括:时间复杂度,空间复杂度。

Tn = Q(f(n))

Tn:代码执行的时间

n:数据规模的大小

f(n):每行代码执行的次数总和

Q:代码的执行时间 Tn 与 f(n) 表达式成正比

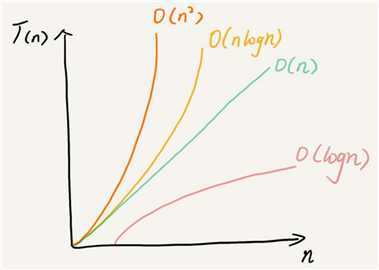

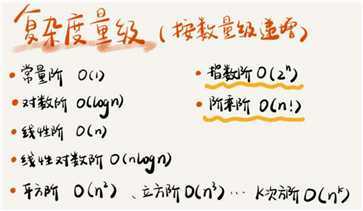

大O这种复杂度表示方法只是表示一种变化趋势。我们通常会忽略掉公式中的常量、低阶、系数,只需要记录一个最大阶的量级就可以了。所以, 我们在分析一个算法、一段代码的时间复杂度的时候,也只关注循环执行次数最多的那一段代码就可以了。这段核心代码执行次数的 n 的量级,就是整段要分析代码的时间复杂度。

例:

int cal(int n) {

int sum = 0;

int i = 1;

for (; i <= n; ++i) {

sum = sum + i;

}

return sum;

}

其中第 2、3 行代码都是常量级的执行时间,与 n 的大小无关,所以对于复杂度并没有影响。循环执行次数最多的是第 4、5 行代码,所以这块代码要重点分析。前面我们也讲过,这两行代码被执行了 n 次,所以总的时间复杂度就是 O(n)。

下面这段代码:

int cal(int n) {

int sum_1 = 0;

int p = 1;

for (; p < 100; ++p) {

sum_1 = sum_1 + p;

}

int sum_2 = 0;

int q = 1;

for (; q < n; ++q) {

sum_2 = sum_2 + q;

}

int sum_3 = 0;

int i = 1;

int j = 1;

for (; i <= n; ++i) {

j = 1;

for (; j <= n; ++j) {

sum_3 = sum_3 + i * j;

}

}

return sum_1 + sum_2 + sum_3;

}

如果 T1(n) = O(f(n)), T2(n) = O(g(n));那么 T(n) = T1(n) * T2(n) = O(f(n)) * O(g(n)) = O(f(n) * g(n))。

也就是说,假设T1(n) = O(n), T2(n) = O(n2),则 T1(n) * T2(n) = O(n3)。落实到具体的代码上,我们可以把乘法法则看成是嵌套循环,举个例子:

int cal(int n) {

int ret = 0;

int i = 1;

for (; i < n; ++i) {

ret = ret + f(i);

}

}

int f(int n) {

int sum = 0;

int i = 1;

for (; i < n; ++i) {

sum = sum + i;

}

return sum;

}

我们单独看 cal() 函数。假设 f() 只是一个普通的操作,那第 4~ 6 行的时间复杂度就是, T1(n) = O(n)。但 f() 函数本身不是一个简单的操作,它的时间复杂度是 T2(n) = O(n),所以,整个 cal() 函数的时间复杂度就是, T(n) = T1(n) * T2(n) = O(n*n) = O(n2)。

O(1)只是常量级时间复杂度的一种表示方法,并不是指只执行了一行代码。比如这段代码,即便有3行,它的时间复杂度也是O(1),而不是O(3)。

int i = 8;

int j = 6;

int sum = i + j;

只要代码的执行时间不随n的增大而增长,这样代码的时间复杂度我们都记作O(1)。或者说, 一般情况下,只要算法中不存在循环语句、递归语句,即使有成千上万行的代码,其时间复杂度也是Ο(1)。

对数阶时间复杂度非常常见,同时也是最难分析的一种时间复杂度。通过一个例子来说明一下。

i=1;

while (i <= n) {

i = i * 2;

}

i=1;

while (i <= n) {

i = i * 3;

}

代码的复杂度由两个数据的规模来决定。

int cal(int m, int n) {

int sum_1 = 0;

int i = 1;

for (; i < m; ++i) {

sum_1 = sum_1 + i;

} int sum_2 = 0;

int j = 1;

for (; j < n; ++j) {

sum_2 = sum_2 + j;

}

return sum_1 + sum_2;

}

空间复杂度全称就是渐进空间复杂度(asymptotic space complexity), 表示算法的存储空间与数据规模之间的增长关系。

举个例子:

void print(int n) {

int i = 0;

int[] a = new int[n];

for (i; i <n; ++i) {

a[i] = i * i;

}

for (i = n-1; i >= 0; --i) {

print out a[i]

}

}

// n表示数组array的长度

int find(int[] array, int n, int x) {

int i = 0;

int pos = -1;

for (; i < n; ++i) {

if (array[i] == x)

pos = i;

}

return pos;

}

// n表示数组array的长度

int find(int[] array, int n, int x) {

int i = 0;

int pos = -1;

for (; i < n; ++i) {

if (array[i] == x) {

pos = i;

break;

}

}

return pos;

}

我们都知道,最好情况时间复杂度和最坏情况时间复杂度对应的都是极端情况下的代码复杂度,发生的概率其实并不大。

为了更好地表示平均情况下的复杂度,需要引入另一个概念:平均情况时间复杂度,简称为平均时间复杂度。

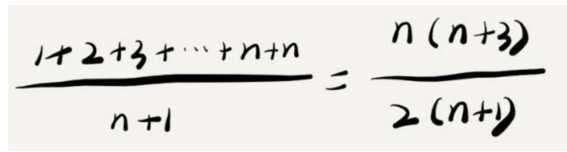

要查找的变量 x 在数组中的位置,有 n+1 种情况:在数组的 0~ n-1 位置中和不在数组中。

我们把每种情况下,查找需要遍历的元素个数累加起来,然后再除以n+1,就可以得到需要遍历的元素个数的平均值,即:

我们知道,时间复杂度的大 O 标记法中,可以省略掉系数、低阶、常量,所以,咱们把刚刚这个公式简化之后,得到的平均时间复杂度就是 O(n)。

这个结论虽然是正确的,但是计算过程稍微有点儿问题。究竟是什么问题呢?我们刚讲的这 n+1 种情况,出现的概率并不是一样的。

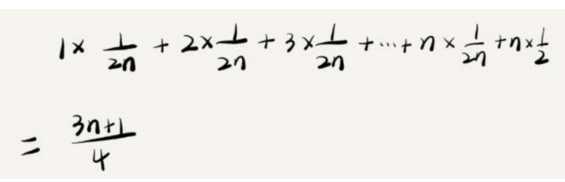

我们知道,要查找的变量 x,要么在数组里,要么就不在数组里。这两种情况对应的概率统计起来很麻烦,为了方便理解,我们假设在数组中与不在数组中的概率都为1/2。

另外,要查找的数据出现在 0~ n-1 这 n 个位置的概率也是一样的,为 1/n。

所以,根据概率乘法法则,要查找的数据出现在 0~ n-1 中任意位置的概率就是 1/(2n)。

因此,前面的推导过程中存在的最大问题就是,没有将各种情况发生的概率考虑进去。如果我们把每种情况发生的概率也考虑进去,那平均时间复杂度的计算过程就变成了这样:

这个值就是概率论中的加权平均值,也叫作期望值,所以平均时间复杂度的全称应该叫加权平均时间复杂度或者期望时间复杂度。

引入概率之后,前面那段代码的加权平均值为 (3n+1)/4。用大 O 表示法来表示,去掉系数和常量,这段代码的加权平均时间复杂度仍然是 O(n)。

实际上,在大多数情况下,我们并不需要区分最好、最坏、平均情况时间复杂度三种情况。很多时候,我们使用一个复杂度就可以满足需求了。

只有同一块代码在不同的情况下,时间复杂度有量级的差距,我们才会使用这三种复杂度表示法来区分。

原文:https://www.cnblogs.com/xiexiandong/p/12979578.html