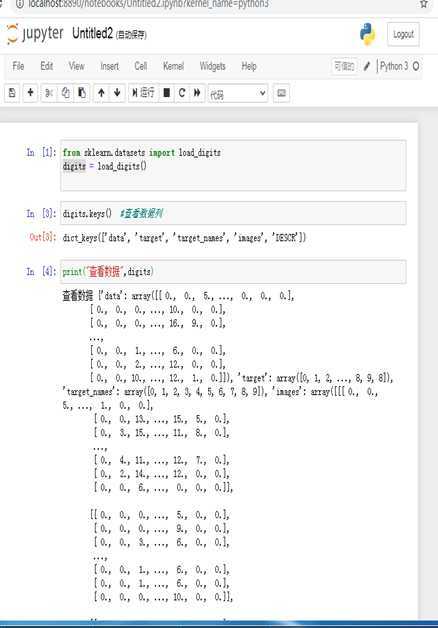

1.手写数字数据集

代码:

1 from sklearn.datasets import load_digits 2 digits = load_digits()

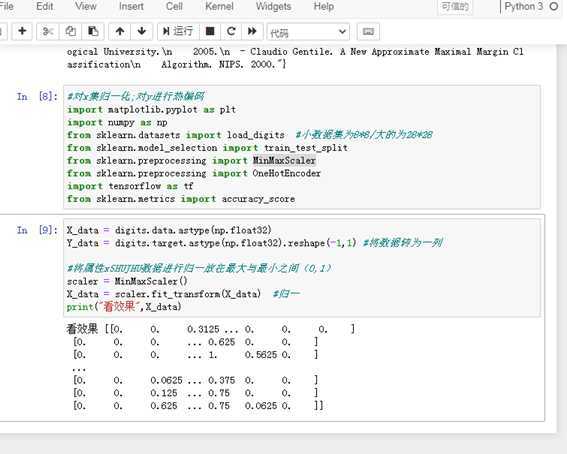

2.图片数据预处理

代码:

1 #对x集归一化;对y进行热编码 2 import matplotlib.pyplot as plt 3 import numpy as np 4 from sklearn.datasets import load_digits #小数据集为8*8/大的为28*28 5 from sklearn.model_selection import train_test_split 6 from sklearn.preprocessing import MinMaxScaler 7 from sklearn.preprocessing import OneHotEncoder 8 import tensorflow as tf 9 from sklearn.metrics import accuracy_score 10 11 X_data = digits.data.astype(np.float32) 12 Y_data = digits.target.astype(np.float32).reshape(-1,1) #将数据转为一列 13 14 #将属性xSHUJHU数据进行归一放在最大与最小之间(0,1) 15 scaler = MinMaxScaler() 16 X_data = scaler.fit_transform(X_data) #归一 17 print("看效果",X_data)

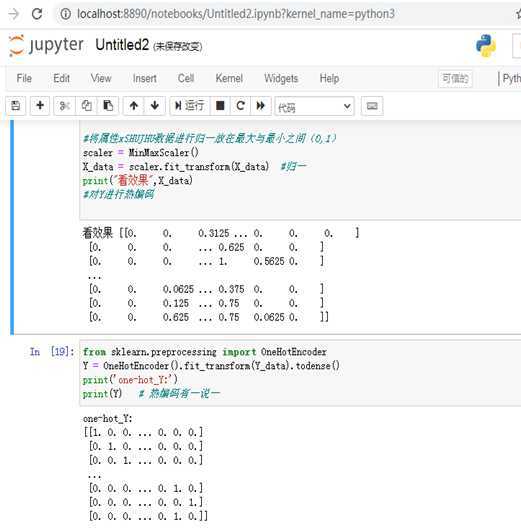

代码:

from sklearn.preprocessing import OneHotEncoder Y = OneHotEncoder().fit_transform(Y_data).todense() print(‘one-hot_Y:‘) print(Y) # 热编码有一说一

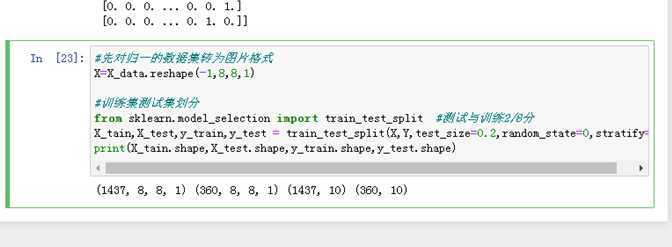

代码:

1 #先对归一的数据集转为图片格式 2 X=X_data.reshape(-1,8,8,1) 3 4 #训练集测试集划分 5 from sklearn.model_selection import train_test_split #测试与训练2/8分 6 X_tain,X_test,y_train,y_test = train_test_split(X,Y,test_size=0.2,random_state=0,stratify=Y) 7 print(X_tain.shape,X_test.shape,y_train.shape,y_test.shape)

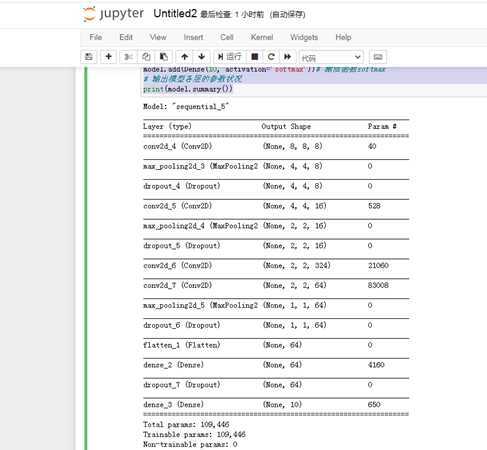

3.设计卷积神经网络结构

读入手写数字识别经过输入层,经过最小维度的卷积层,经过池化,越往下卷积核的数目越多,提出的特征也越多;反复后最终到达全链接层。即有两个连续的卷积-池化就会知道第二个卷积是在获得图片的压缩版。

from tensorflow.keras.models import Sequential from tensorflow.keras.layers import Dense,Dropout,Conv2D,MaxPool2D,Flatten model = Sequential() # 建立模型 #设定卷积核 ks = (2, 2) #输入层(1层)此处input_shape需要指定训练集的数据,往下之后是会自动推导 model.add(Conv2D(filters=8, kernel_size=ks, padding=‘same‘, input_shape=X_tain.shape[1:], activation=‘relu‘)) model.add(MaxPool2D(pool_size=(2, 2))) # 池化层 model.add(Dropout(0.25)) # 防止过拟合丢掉1/4的链接 model.add(Conv2D(filters=16, kernel_size=ks, padding=‘same‘, activation=‘relu‘))# 第2卷积层 model.add(MaxPool2D(pool_size=(2, 2)))# 池化 model.add(Dropout(0.25))# 防止过拟合丢掉1/4的链接 model.add(Conv2D(filters=324, kernel_size=ks, padding=‘same‘, activation=‘relu‘))# 第三卷积层 model.add(Conv2D(filters=64, kernel_size=ks, padding=‘same‘, activation=‘relu‘))# 第四卷积层 model.add(MaxPool2D(pool_size=(2, 2)))# 池化 model.add(Dropout(0.25)) model.add(Flatten())# 平坦层 model.add(Dense(64, activation=‘relu‘))# 全连接层 model.add(Dropout(0.25)) model.add(Dense(10, activation=‘softmax‘))# 激活函数softmax # 输出模型各层的参数状况 print(model.summary())

4.模型训练

5.模型评价

原文:https://www.cnblogs.com/ys-hl-lo/p/13091658.html