机器学习中几乎都可以看到损失函数后面会添加一个额外项,常用的额外项一般有两种,一般英文称作 ?1?-norm 和?2?-norm,中文称作 L1正则化 和 L2正则化,或者 L1范数 和 L2范数。

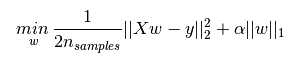

L1正则化和L2正则化可以看做是损失函数的惩罚项。所谓『惩罚』是指对损失函数中的某些参数做一些限制。对于线性回归模型,使用L1正则化的模型建叫做Lasso回归,使用L2正则化的模型叫做Ridge回归(岭回归)。下图是Python中Lasso回归的损失函数,式中加号后面一项 即为L1正则化项。

即为L1正则化项。

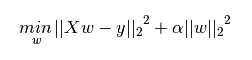

下图是Python中Ridge回归的损失函数,式中加号后面一项 即为L2正则化项

即为L2正则化项

一般回归分析中ω表示特征的系数,从上式可以看到正则化项是对系数做了处理(限制)。L1正则化和L2正则化的说明如下:

一般都会在正则化项之前添加一个系数,Python的机器学习包sklearn中用 α 表示,一些文章也用 λ 表示。这个系数需要用户指定。

L1正则化和L2正则化的作用:

稀疏模型与特征选择的关系

稀疏矩阵指的是很多元素为0,只有少数元素是非零值的矩阵,即得到的线性回归模型的大部分系数都是0. 通常机器学习中特征数量很多,例如文本处理时,如果将一个词组(term)作为一个特征,那么特征数量会达到上万个(bigram)。在预测或分类时,那么多特征显然难以选择,但是如果代入这些特征得到的模型是一个稀疏模型,表示只有少数特征对这个模型有贡献,绝大部分特征是没有贡献的,或者贡献微小(因为它们前面的系数是0或者是很小的值,即使去掉对模型也没有什么影响),此时我们就可以只关注系数是非零值的特征。这就是稀疏模型与特征选择的关系

这部分内容将解释为什么L1正则化可以产生稀疏模型(L1是怎么让系数等于零的),以及为什么L2正则化可以防止过拟合

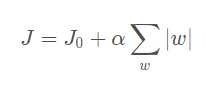

假设有如下带L1正则化的损失函数:

其中 J0 是原始的损失函数,加号后面的一项是L1正则化项,α 是正则化系数。注意到L1正则化是权值的绝对值之和,J 是带有绝对值符号的函数,因此 J 是不完全可微的。机器学习的任务就是要通过一些方法(比如梯度下降)求出损失函数的最小值。当我们在原始损失函数J0J_0J0?后添加L1正则化项时,相当于对J0J_0J0?做了一个约束。令L=α∑w∣w∣L = \alpha \sum_w{|w|}L=α∑w?∣w∣,则J=J0+LJ = J_0 + LJ=J0?+L,此时我们的任务变成在LLL约束下求出J0J_0J0?取最小值的解。考虑二维的情况,即只有两个权值w1w^1w1和w2w^2w2,此时L=∣w1∣+∣w2∣L = |w^1|+|w^2|L=∣w1∣+∣