我们要抓取下面这个网站上的所有图书列表:

https://www.epubit.com/books

创建一个新的python文件,写入如下代码:

import requests url = ‘https://www.epubit.com/books‘ res = requests.get(url) print(res.text)

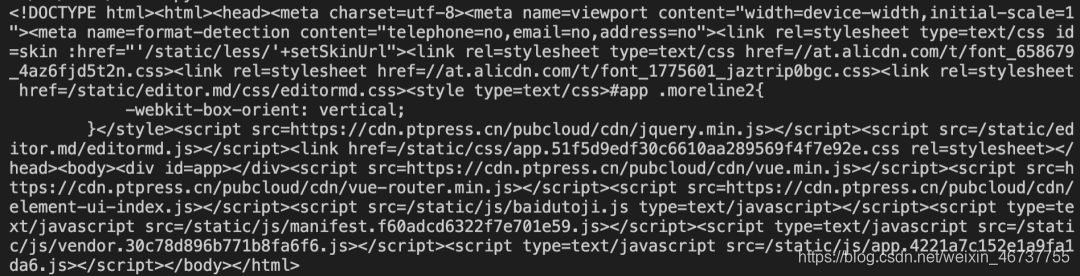

运行发现打印结果如下:

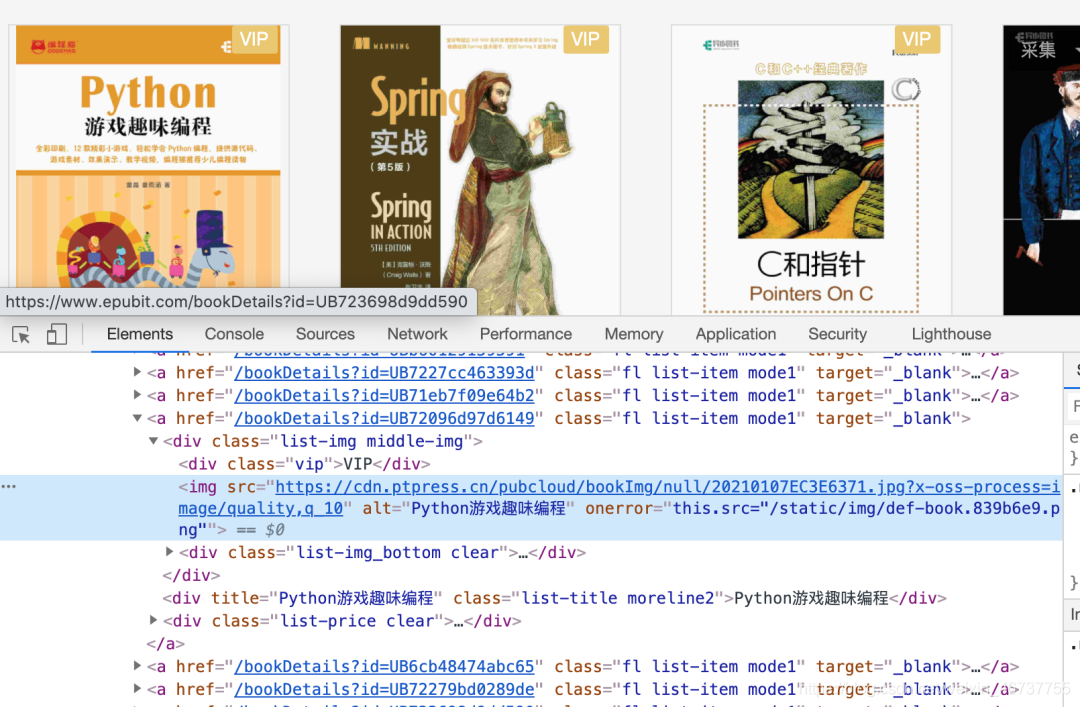

这里面根本没有图书的信息。但使用浏览器检查器可以看到图书的信息:

我们碰到了一个基于前后端分离的网站,或者说一个用JavaScript获取数据的网站。这种网站的数据流程是这样的:

为了抓取这样的网站,有两个办法:

很多人学习python,不知道从何学起。

很多人学习python,掌握了基本语法过后,不知道在哪里寻找案例上手。

很多已经做案例的人,却不知道如何去学习更加高深的知识。

那么针对这三类人,我给大家提供一个好的学习平台,免费领取视频教程,电子书籍,以及课程的源代码!

QQ群:810735403

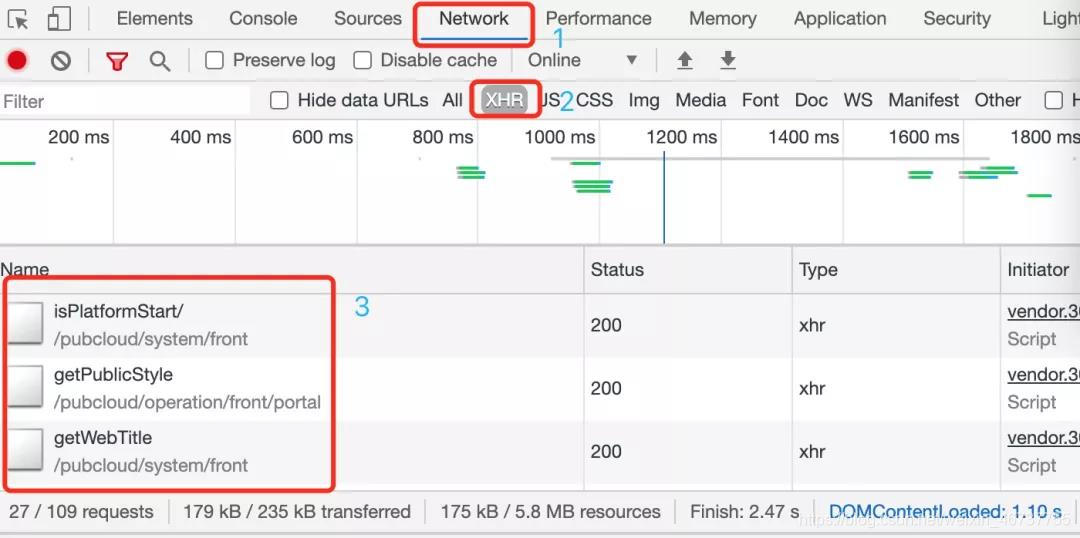

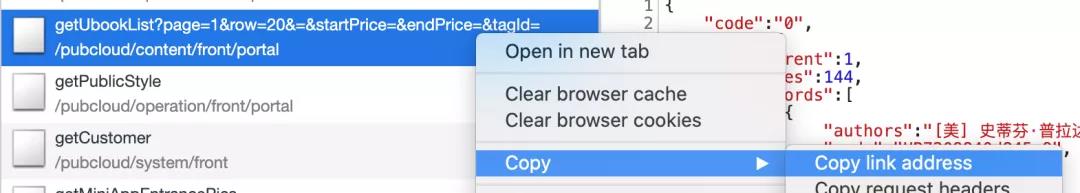

打开谷歌浏览器的检查器,按图中的指示操作:

再来理解一下浏览器打开一个网页的过程,一般并不是一个请求返回了所有的内容,而是包含多个步骤:

所以我们看到有这么不同类型的请求:XHR, JS,CSS,Img,Font, Doc等。

我们爬取的网站发送了很多个XHR请求,分别用来请求图书列表,网页的菜单,广告信息,页脚信息等。我们要从这些请求中找出图书的请求。

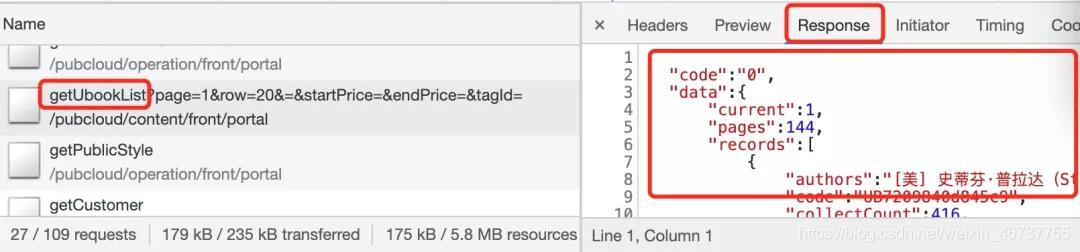

具体操作步骤如图:

Javascript请求返回的格式通常是JSON格式,这是一种JavaScript的数据格式,里面包含用冒号隔开的一对对数据,比较容易看懂。JSON很像Python中的字典。

在众多的请求中,可以根据请求的名字大致判断,提高效率。比如上图中getUBookList看起来就像是获取图书列表。点开查看,返回的果然是图书列表。

请记住这个链接的地址和格式,后面要用到:

https://www.epubit.com/pubcloud/content/front/portal/getUbookList?page=1&row=20&=&startPrice=&endPrice=&tagId= 分析一下,可以看到:

为了验证这个设想打开谷歌浏览器,在地址栏中输入以下网址:

https://www.epubit.com/pubcloud/content/front/portal/getUbookList?page=1&row=20&=&startPrice=&endPrice=&tagId=

可是得到了如下的返回结果:

{ "code": "-7", "data": null, "msg": "系统临时开小差,请稍后再试~", "success": false }

这并不是系统出了问题,而是系统检测到我们是非正常的请求,拒绝给我们返回数据。

这说明除了发送这个URL,还需要给服务器传送额外的信息,这些信息叫做Header,翻译成中文是请求头的意思。

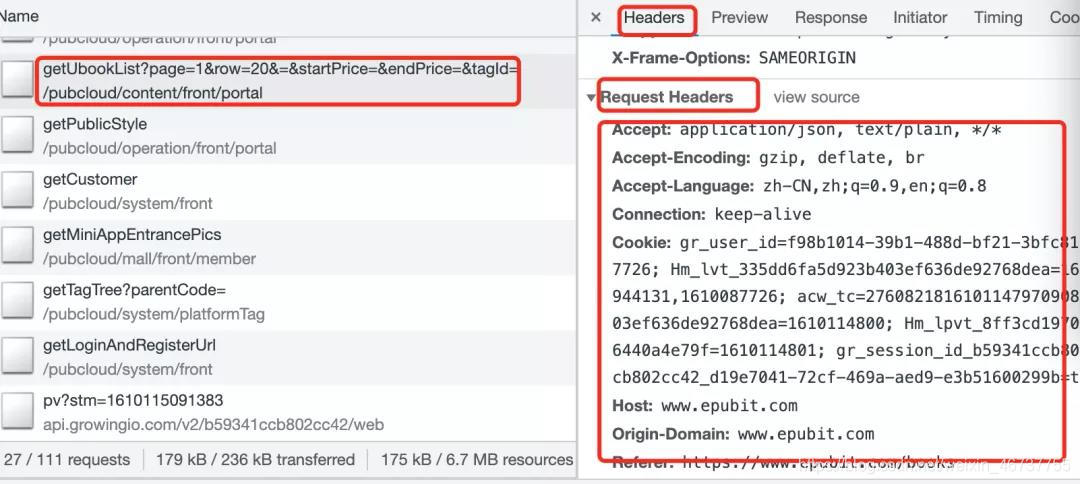

在下图中可以看到正常的请求中包含了多个请求头:

为了让服务器正常处理请求,我们要模拟正常的请求,也添加相应的header。如果给的Header也都一样,服务器根本不可能识别出我们是爬虫。后面我们会学习如何在发送请求时添加header。

但通常服务器并不会检查所有的Header,可能只要添加一两个关键Header就可以骗服务器给我们数据了。但我们要一个个测试那些Header是必须的。

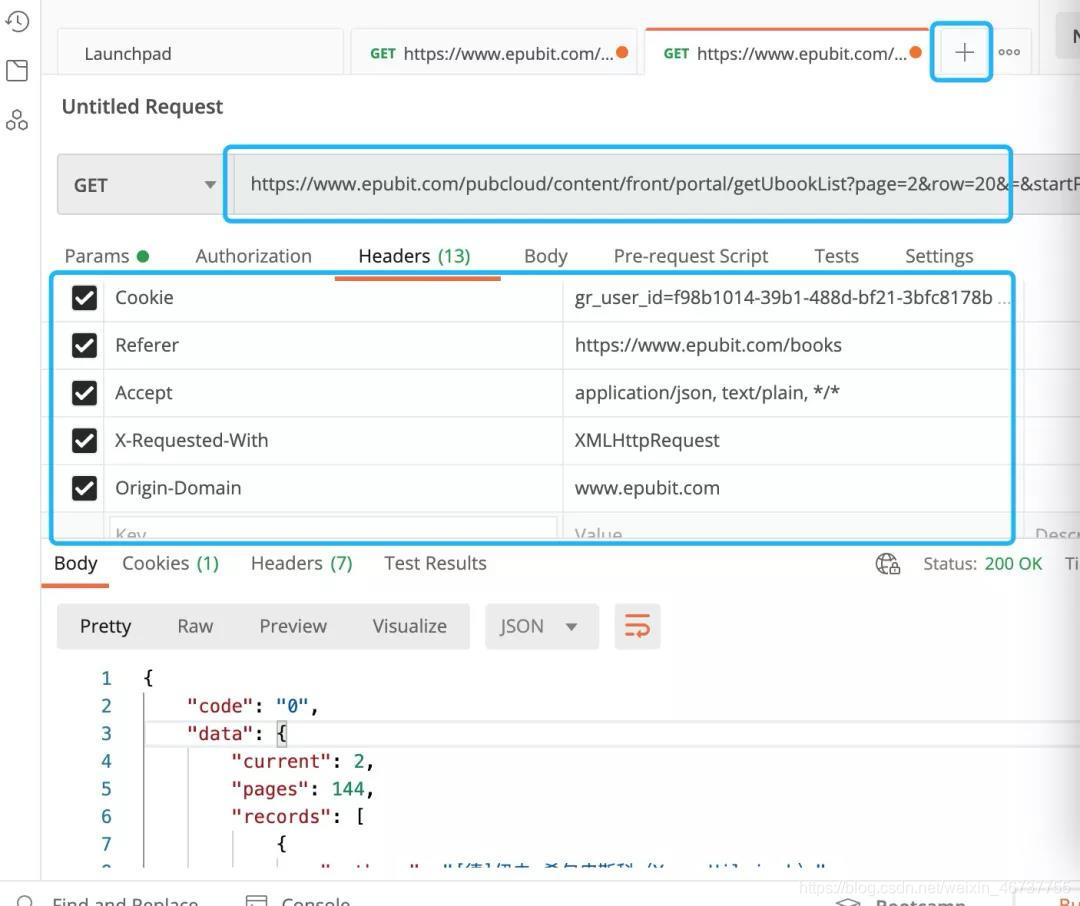

在浏览器中无法添加Header,为了发送带Header的HTTP请求,我们要使用另一个软件叫做Postman。这是一个API开发者和爬虫工程师最常使用的工具之一。

首先在postman的官网下载:www.postman.com。根据指示一步步安装软件,中间没有额外的设置。

打开postman后可以看到如下界面:

这些Header的名字和值可以在检查器中复制过来。如果自己拼写,注意千万不要写错。

我们来了解一下几个常见的header:

User-Agent: 这个Header表示请求者是谁,一般是一个包括详细版本信息的浏览器的名字,比如:Mozilla/5.0

(Macintosh; Intel Mac OS X 10_15_7) AppleWebKit/537.36 (KHTML, like

Gecko) Chrome/87.0.4280.88 Safari/537.36

如果爬虫不添加这个Header,服务器一下就能识别出这是不正常请求,可以予以拒绝。当然,是否拒绝取决于程序员的代码逻辑。

Cookie: 如果一个网站需要登录,登录的信息就保存在Cookie中。服务器通过这个Header判定是否登陆了,登陆的是谁。

假设我们要自动在京东商城下单,我们可以先人工登录,复制Cookie的值,用Python发送请求并包含这个Cookie,这样服务器就认为我们已经登陆过了,允许我们下单或做其他操作。如果在程序中加上计时的功能,指定具体下单的时间点,这就是秒杀程序。这是爬取需要登录的网站的一种常用方法。

Accept:指浏览器接受什么格式的数据,比如**application/json, text/plain,

*/***是指接受JSON,文本数据,或者任何数据。

Origin-Domain: 是指请求者来自那个域名,这个例子中是:www.epubit.com

关于更多的HTTP的Header,可以在网上搜索HTTP Headers学习。

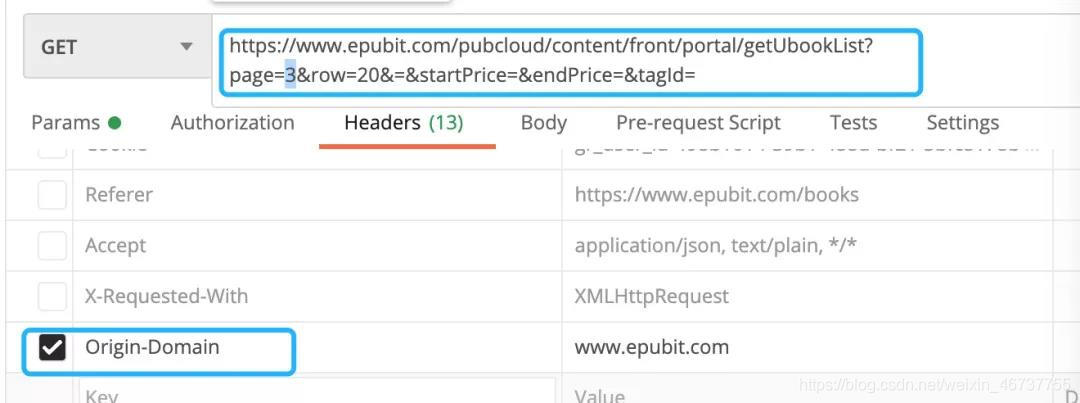

我一个个添加常用的Header,但服务器一直不返回数据,直到添加了Origin-Domain这个Header。这说明这个Header是必备条件。

网页的后台程序有可能不检查Header,也有可能检查一个Header,也有可能检查多个Header,这都需要我们尝试才能知道。

既然Origin-Domain是关键,也许后台程序只检查这一个Header,我们通过左边的选择框去掉其他的Header,只保留Origin-Domain,请求仍然成功,这说明后台只检查了这一个Header:

然后修改地址栏中的page参数,获取其他的页,比如截图中修改成了3,再发送请求,发现服务器返回了新的数据(其他的20本书)。这样我们的请求过程就成功了。

开发爬虫,主要的时间是分析,一旦分析清楚了,爬取代码并不复杂:

import requests def get_page(page=1): ‘‘‘抓取指定页的数据,默认是第1页‘‘‘ # 使用page动态拼接URL url = f‘https://www.epubit.com/pubcloud/content/front/portal/getUbookList?page={page}&row=20&=&startPrice=&endPrice=&tagId=‘ headers = {‘Origin-Domain‘: ‘www.epubit.com‘} # 请求的时候同时传入headers res = requests.get(url, headers=headers) print(res.text) get_page(5)

这里我们测试了抓取第5页的数据,比对打印出的JSON数据和网页上的第5页数据,结果是匹配的。

现在我们去分析JSON的数据结构,再来完善这个程序。

JSON就像Python中的字典,用大括号存放数据,用冒号分割键和值。下面是省略的JSON数据:

{ "code": "0", "data": { "current": 1, //第一页 "pages": 144, //一共几页 "records": [ //很多本书的信息放在方括号中 { "authors": "[美] 史蒂芬·普拉达(Stephen Prata)", //作者 "code": "UB7209840d845c9", //代码 "collectCount": 416, //喜欢数 "commentCount": 64, //评论数 "discountPrice": 0, //折扣价 "downebookFlag": "N", "fileType": "", ... }, { "authors": "笨叔", "code": "UB7263761464b35", "collectCount": 21, "commentCount": 3, "discountPrice": 0, "downebookFlag": "N", "fileType": "", ... }, ... ], "size": 20, "total": 2871 }, "msg": "成功", "success": true }

我们来学习一下这个JSON格式:

{ "authors": "[美] 史蒂芬·普拉达(Stephen Prata)", //书名 "code": "UB7209840d845c9", //代码 "collectCount": 416, //喜欢数 "commentCount": 64, //评论数 "discountPrice": 0, //折扣0,表示没有折扣 ... "forSaleCount": 3, //在售数量 ... "logo": "https://cdn.ptpress.cn/pubcloud/bookImg/A20190961/20200701F892C57D.jpg", "name": "C++ Primer Plus 第6版 中文版", //书名 ... "price": 100.30, //价格 ... }

每本书的信息有很多个字段,这里省略掉了很多字段,给重要的信息添加了注释。

现在来完善上面的程序,从JSON中解析出我们要的数据,为了简化,我们只抓取:书名,作者,编号和价格。

程序框架:

import requests import json import time class Book: # --省略-- def get_page(page=1): # --省略-- books = parse_book(res.text) return books def parse_book(json_text): #--省略-- all_books = [] for i in range(1, 10): print(f‘======抓取第{i}页======‘) books = get_page(i) for b in books: print(b) all_books.extend(books) print(‘抓完一页,休息5秒钟...‘) time.sleep(5)

下面来看看,被省略掉的部分:

Book类:

class Book: def __init__(self, name, code, author, price): self.name = name self.code = code self.author = author self.price = price def __str__(self): return f‘书名:{self.name},作者:{self.author},价格:{self.price},编号:{self.code}‘

下面是__str__函数是一个魔法函数,当我们使用print打印一个Book对象的时候,Python会自动调用这个函数。

parse_book函数:

import json def parse_book(json_text): ‘‘‘根据返回的JSON字符串,解析书的列表‘‘‘ books = [] # 把JSON字符串转成一个字典dict类 book_json = json.loads(json_text) records = book_json[‘data‘][‘records‘] for r in records: author = r[‘authors‘] name = r[‘name‘] code = r[‘code‘] price = r[‘price‘] book = Book(name, code, author, price) books.append(book) return books

抓取基于 JavaScript 的网页,复杂主要在于分析过程,一旦分析完成了,抓取的代码比 HTML 的页面还要更简单清爽!

810735403,群里都是学Python开发的,如果你正在学Python 爬虫进阶 - 前后端分离有什么了不起,过程超详细!

原文:https://www.cnblogs.com/peig/p/14292273.html