准备认真研究机器学习下,在看《机器学习实战》这本书。这本书唯一的好处的就是有代码,对算法原理的解释实在太少。不过还好,有百度,有谷歌。

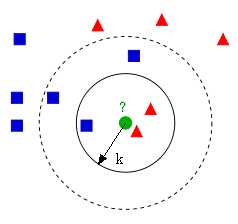

k近邻算法(k-Nearest Neighbor,KNN) 是机器学习里最基本的分类方法,主要的思想的就是:在训练数据集中找到k个最近邻的实例,类别由这k个近邻中占最多的实例的类别来决定。如下图,当k=3时,即选择最近的3个点,判断他们的类别,于是可以得出绿色的输入实例应该为红色;同理,当k=5时,可以结果由变成蓝色。

KNN 方法虽然从原理上也依赖于极限定理,但在类别决策时,只与极少量的相邻样本有关。由于 KNN 方法主要靠周围有限的邻近的样本,而不是靠判别类域的方法来确定所属类别的,因此对于类域的交叉或重叠较多的待分样本集来说,KNN 方法较其他方法更为适合。

K 近邻算法使用的模型实际上对应于对特征空间的划分。K 值的选择,距离度量和分类决策规则是该算法的三个基本要素:

1、K 值的选择会对算法的结果产生重大影响。K值较小意味着只有与输入实例较近的训练实例才会对预测结果起作用,但容易发生过拟合;如果 K 值较大,优点是可以减少学习的估计误差,但缺点是学习的近似误差增大,这时与输入实例较远的训练实例也会对预测起作用,是预测发生错误。在实际应用中,K 值一般选择一个较小的数值,通常采用交叉验证的方法来选择最有的 K 值。随着训练实例数目趋向于无穷和 K=1 时,误差率不会超过贝叶斯误差率的2倍,如果K也趋向于无穷,则误差率趋向于贝叶斯误差率。

2、该算法中的分类决策规则往往是多数表决,即由输入实例的 K 个最临近的训练实例中的多数类决定输入实例的类别

3、距离度量一般采用 Lp 距离,当p=2时,即为欧氏距离,在度量之前,应该将每个属性的值规范化,这样有助于防止具有较大初始值域的属性比具有较小初始值域的属性的权重过大。

该算法在分类时有个主要的不足是,当样本不平衡时,如一个类的样本容量很大,而其他类样本容量很小时,有可能导致当输入一个新样本时,该样本的 K 个邻居中大容量类的样本占多数。 该算法在分类时有个主要的不足是,当样本不平衡时,如一个类的样本容量很大,而其他类样本容量很小时,有可能导致当输入一个新样本时,该样本的 K 个邻居中大容量类的样本占多数。

该算法只计算“最近的”邻居样本,某一类的样本数量很大,那么或者这类样本并不接近目标样本,或者这类样本很靠近目标样本。无论怎样,数量并不能影响运行结果。可以采用权值的方法(和该样本距离小的邻居权值大)来改进。该方法的另一个不足之处是计算量较大,因为对每一个待分类的文本都要计算它到全体已知样本的距离,才能求得它的 K 个最近邻点。目前常用的解决方法是事先对已知样本点进行剪辑,事先去除对分类作用不大的样本。该算法比较适用于样本容量比较大的类域的自动分类,而那些样本容量较小的类域采用这种算法比较容易产生误分。该算法只计算“最近的”邻居样本,某一类的样本数量很大,那么或者这类样本并不接近目标样本,或者这类样本很靠近目标样本。无论怎样,数量并不能影响运行结果。可以采用权值的方法(和该样本距离小的邻居权值大)来改进。该方法的另一个不足之处是计算量较大,因为对每一个待分类的文本都要计算它到全体已知样本的距离,才能求得它的 K 个最近邻点。目前常用的解决方法是事先对已知样本点进行剪辑,事先去除对分类作用不大的样本。该算法比较适用于样本容量比较大的类域的自动分类,而那些样本容量较小的类域采用这种算法比较容易产生误分。

KNN 算法不仅可以用于分类,还可以用于回归。通过找出一个样本的 K 个最近邻居,将这些邻居的属性的平均值赋给该样本,就可以得到该样本的属性。更有用的方法是将不同距离的邻居对该样本产生的影响给予不同的权值(weight),如权值与距离成正比。

实现 K 近邻算法时,主要考虑的问题是如何对训练数据进行快速 K 近邻搜索,这在特征空间维数大及训练数据容量大时非常必要。

from http://www.leexiang.com/k-nearest-neighbor-algorithm

#-*- coding: UTF-8 -*- from numpy import * import operator import matplotlib import matplotlib.pyplot as plt def createdataset(): group = array([[1.0,1.1],[1.0,1.0],[0,0],[0,0.1]]) labels = [‘A‘,‘A‘,‘B‘,‘B‘] return group,labels group,label = createdataset() print group print label def classify0(intX,dataset,labels,k): datasetSize = dataset.shape[0] #shape[0] 返回行数 diffmat = tile(intX,(datasetSize,1)) - dataset # tilee 函数重复 sqdiffmat = diffmat**2 sqdistances = sqdiffmat.sum(axis = 1) #axis= 1每行元素相加 axis= 0 列元素相加 distances = sqdistances**0.5 sortedDistIndicies = distances.argsort() # argsort函数对数组排序,返回值是下标,默认是从小到大排序 classCount = {} for i in range(k): votelabel = labels[sortedDistIndicies[i]] classCount[votelabel] = classCount.get(votelabel,0) + 1 #get函数,如果key不存在返回第二个参数传入的默认值 sortedClassCount = sorted(classCount.iteritems(),key = operator.itemgetter(1),reverse = True) # iteritems与items,items返回的是字典,iteritems返回的是迭代器,在迭代时效率更高。perator模块提供的itemgetter函数用于获取对象的哪些维的数据,参数为一些序号 return sortedClassCount[0][0]

def file2mattrix(filename): fr = open(filename) arrayOlines = fr.readlines() #注意read() readline() readlines()的区别 numberOflines = len(arrayOlines) returnMat = zeros((numberOflines,3)) classLabelVector = [] index = 0 for line in arrayOlines: line = line.strip(‘ ‘) # strip 删除字符,默认情况是删除空白符 换行符和制表符 listFromLine = line.split(‘\t‘) #split分割 returnMat[index,:] = listFromLine[0:3] if listFromLine[-1] == ‘largeDoses\n‘ : # 改标签 classLabelVector.append(3) elif listFromLine[-1] == ‘smallDoses\n‘: # 日,这个回车键把我害死了 classLabelVector.append(2) elif listFromLine[-1] == ‘didntLike\n‘: classLabelVector.append(1) index += 1 return returnMat,classLabelVector datingDataMat,datinglabel = file2mattrix(‘datingTestSet.txt‘) print datinglabel[0:50] print datingDataMat fig = plt.figure() #画图 ax = fig.add_subplot(121) ax.scatter(datingDataMat[:,1],datingDataMat[:,2],15.0*array(datinglabel),15.0*array(datinglabel)) #plt.show() ax1 = fig.add_subplot(122) ax1.scatter(datingDataMat[:,0],datingDataMat[:,1],30*array(datinglabel),30*array(datinglabel)) plt.show() #归一化 def autoNorm(dataset): maxVals = dataset.max(0) # 每一列的最大值 minVals = dataset.min(0) ranges = maxVals - minVals normDataSet = zeros(shape(dataset)) m = dataset.shape[0] normDataSet = dataset - tile(minVals,(m,1)) normDataSet = normDataSet/tile(ranges,(m,1)) #每个元素相除 return normDataSet,ranges,minVals normat,ranges,minVals = autoNorm(datingDataMat) print normat def datingClassTest(): # 取前10%的数据作为测试样本,其余的作为训练样本 hoRatio = 0.1 datingDataMat,datinglabel = file2mattrix(‘datingTestSet.txt‘) normMat,ranges,minVals = autoNorm(datingDataMat) m = normMat.shape[0] numTestVecs = int(m*hoRatio) errorCount = 0.0 for i in range(numTestVecs): classifierResult = classify0(normMat[i,:],normMat[numTestVecs:m,:],datinglabel[numTestVecs:m],3) print "the classifier came back with : %d, the real answer is : %d "% (classifierResult,datinglabel[i]) if (classifierResult != datinglabel[i]): errorCount += 1.0 print "the total error tate is : %f" % (errorCount/float(numTestVecs)) datingClassTest() def classifpenson(): resultlist = [‘not at all‘,‘is small like‘,‘in large does‘] percentTats = float(raw_input("percentage of time spent playing video game")) ffmiles = float(raw_input("frequent flier miles earned per year")) iceCreeam = float(raw_input("liters of ice cream comsumed per year")) datingDataMat,datinglabel = file2mattrix(‘datingTestSet.txt‘) normMat,ranges,minVals = autoNorm(datingDataMat) inArr = array([ffmiles,percentTats,iceCreeam]) classifierResult = classify0((inArr-minVals)/ranges,normMat,datinglabel,3) print "you probably like this person: " + resultlist[classifierResult-1] classifpenson()

机器学习02-----k近邻算法,布布扣,bubuko.com

原文:http://www.cnblogs.com/lpctm/p/3614981.html